এটি বিশ্বাস করা সহজ যে এআই মানুষের কোনও কিছুর দ্বারপ্রান্তে রয়েছে। সঠিক প্রম্পট এবং একটি সুষম মডেলের সাথে, আজকের সিস্টেমগুলি আকর্ষণীয়ভাবে সুসংগত চিন্তাভাবনা তৈরি করতে পারে, ধাঁধা সমাধান করতে পারে এবং তাদের যুক্তির মধ্য দিয়ে যেতে পারে। তবে আপনি যখন ডায়ালটি ঘুরিয়ে দেন তখন কী ঘটে, যখন সমস্যাগুলি আরও কঠিন, আরও কাঠামোগত হয়ে ওঠে, প্রকৃত যুক্তির আরও দাবী করে?

যুক্তির জন্য একটি ল্যাব

অ্যাপলের নতুন কাগজ, চিন্তাভাবনা মায়াডাব্লুডাব্লুডিসি 2025 এর আগে নিঃশব্দে প্রকাশিত হয়েছে, আমরা এলএলএম স্পেসে নির্ভর করতে এসেছি এমন অনেকগুলি অনুমানকে চ্যালেঞ্জ জানায়। এটি বেঞ্চমার্ক স্কোর বা বাস্তব-বিশ্বের কার্যগুলিতে ফোকাস করে না। পরিবর্তে, এটি পরীক্ষা করে যে কীভাবে যুক্তিযুক্ত মডেলগুলি দৃ ly ়ভাবে নিয়ন্ত্রিত অবস্থার অধীনে আচরণ করে, যেখানে যৌক্তিক কাঠামো সংরক্ষণ করা হয় তবে টাস্ক জটিলতা ক্রমবর্ধমানভাবে বৃদ্ধি পায়।

এই সেটআপটি বিভ্রান্তি দূরে সরিয়ে দেয়। কোন বিশ্ব জ্ঞান নেই। কোনও ডেটা দূষণ নেই। মডেলগুলি কাঠামোগত, রচনাগত উপায়ে ভাবতে চাপ দেওয়া হয় তখন কী ঘটে তা পৃষ্ঠের জন্য ডিজাইন করা, ধাঁধা-জাতীয় পরিবেশগুলি কেবল পরিষ্কার করুন। এবং যা উত্থিত হয় তা উল্লেখযোগ্যভাবে সামঞ্জস্যপূর্ণ: সাধারণ এবং মাঝারি জটিল কাজগুলিতে দৃ performance

আচরণের ব্যর্থতা

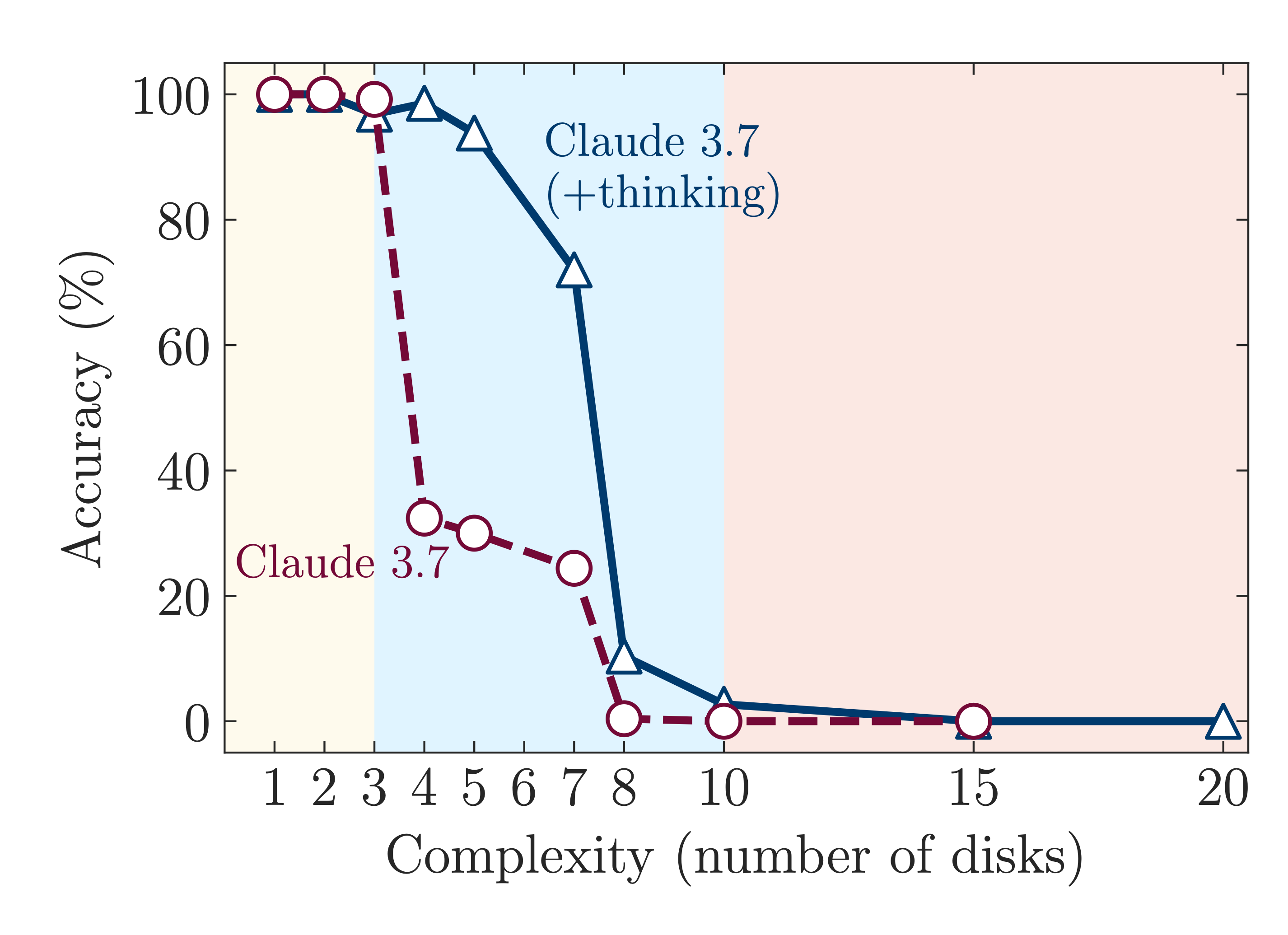

এই কাগজটি কী আলাদা করে দেয় তা হ’ল এটি প্যাটার্ন-ম্যাচিং শর্টকাটগুলি থেকে প্রকৃত যুক্তি বিচ্ছিন্ন করে। এবং ফলাফল আকর্ষণীয় হয়। মডেল পারফরম্যান্স ধীরে ধীরে হ্রাস পায় না। এটা ধসে পড়ে। একটি নির্দিষ্ট পয়েন্টের বাইরে, এমনকি ক্লড 3.7 সনেট থিংকিং, ওপেনাইয়ের ও 1/ও 3, এবং ডিপসেক আর 1 এর মতো শীর্ষ স্তরের মডেলগুলি সমস্যাগুলি সমাধান করা বন্ধ করে দেয়। নির্ভুলতা শূন্যে নেমে আসে। টোকেনের উত্পন্ন সংখ্যার দ্বারা পরিমাপ করা যুক্তিযুক্ত প্রচেষ্টা আসলে হ্রাস পায়, এমনকি প্রচুর পরিমাণে গণনা বাজেট থেকে যায়।

এই মডেলগুলি কেবল কঠিন সমস্যার সাথে লড়াই করে না।

তারা চেষ্টা বন্ধ করে দেয়। তারা হাল ছেড়ে দেয়।

চালিয়ে যাওয়ার গণনা ক্ষমতা থাকা সত্ত্বেও তারা তা করে না। তারা প্রক্রিয়াটি শর্টকাট করে, পদক্ষেপগুলি এড়িয়ে যায় বা অপ্রাসঙ্গিক পথে ডিফল্ট করে। এটি সম্পদের ব্যর্থতা নয়। এটি আচরণের ব্যর্থতা।

আরও আশ্চর্যের বিষয় হল, অ্যালগরিদম নিজেই সরবরাহ করা কোনও উপকারে আসে না। একটি পরীক্ষায়, গবেষকরা হ্যানয়ের পুরো টাওয়ার এম্বেড করেছিলেন () প্রম্পটে অ্যালগরিদম। মডেলটি আরও জটিল সংস্করণগুলিতে এখনও ব্যর্থ হয়েছে। ব্যবধানটি কী করতে হবে তা জানার মধ্যে ছিল না, সেই জ্ঞানটি দীর্ঘতর ক্রমগুলির উপর নির্ভরযোগ্যভাবে কার্যকর করার মধ্যে ছিল।

এমনকি সহজ কাজগুলিতেও আচরণটি বিপরীত হতে পারে। যুক্তিযুক্ত মডেলগুলি প্রায়শই ওভারথিং করে। তারা অপ্রয়োজনীয় পদক্ষেপ উত্পন্ন করে, নিজেকে বিভ্রান্ত করে বা পথ ঘুরিয়ে দেয়, কখনও কখনও তারা ইতিমধ্যে খুঁজে পাওয়া সঠিক উত্তরগুলি থেকে দূরে থাকে। বিপরীতে, স্ট্যান্ডার্ড এলএলএম, কোনও যুক্ত স্ক্যাফোল্ডিং ছাড়াই প্রায়শই আরও ভাল সম্পাদন করে, কারণ তারা গভীরতার অনুকরণ করার চেষ্টা করছে না।

ব্যর্থতার প্রান্তিক

কাগজ থেকে একটি দরকারী ফ্রেমিং হ’ল এটির তিনটি পারফরম্যান্স ব্যবস্থার সনাক্তকরণ, ব্যর্থতার স্পষ্ট প্রান্ত দ্বারা পৃথক করা। কম-জটিলতার কার্যগুলিতে, স্ট্যান্ডার্ড এলএলএমগুলি আসলে যুক্তিযুক্ত মডেলগুলিকে ছাড়িয়ে যায়। মাঝারি-জটিলতার কাজগুলিতে, এলআরএম তাদের যুক্তিযুক্ত স্ক্যাফোল্ডগুলির কারণে একটি প্রান্ত রয়েছে। তবে উচ্চ-জটিলতার কাজে উভয়ই পুরোপুরি ধসে পড়ে।

এটি কেবল প্রযুক্তিগত বিশদ নয়। এটিতে গুরুতর নকশার প্রভাব রয়েছে। আপনি যদি এই সিস্টেমগুলিকে বাস্তব বিশ্বে মোতায়েন করছেন তবে আপনার ব্যবহারের ক্ষেত্রে কোনটি কার্যকর হয় তা জানা গুরুত্বপূর্ণ। ক্লিফটি না হওয়া পর্যন্ত তীক্ষ্ণ এবং অদৃশ্য।

কাঠামোগত বাজে কথা

সম্ভবত সবচেয়ে উদ্বেগজনক সন্ধানটি হ’ল ব্যর্থতা দেখতে কেমন। এমনকি যখন মডেলগুলি সম্পূর্ণ ভুল হয় তখনও তারা প্ররোচিত শোনায়। যুক্তিটি সাবলীল, ব্যাখ্যাগুলি কাঠামোগত করা হয় এবং সিদ্ধান্তগুলি আত্মবিশ্বাসের সাথে সরবরাহ করা হয়। তবে যুক্তি ধরে নেই। কোনও অনিশ্চয়তার পতাকা নেই, কোনও স্ব-সংশোধন, কোনও সংকেত নেই যে কোনও কিছু ভুল হয়েছে।

এটাই মায়া কাগজটি এত ভালভাবে ক্যাপচার করে। এটি কেবল মডেলগুলি ব্যর্থ হয় না – এটি এমনভাবে ব্যর্থ হয় যা তারা চিন্তাভাবনার মতো দেখায়। এবং যখন এটি ঘটে তখন সীমানা যেখানে থাকে তা চিহ্নিত করা আরও শক্ত হয়ে যায়।

বন্ধ চিন্তা

এটি ব্যর্থতা সম্পর্কে কোনও কাগজ নয়। এটি সীমা সম্পর্কে একটি কাগজ। অ্যাপলের কাজটি আজকের মডেলগুলি কোথায় সম্পাদন করে এবং কোথায় সেগুলি কম পড়ে তার একটি পরিষ্কার মানচিত্র সরবরাহ করে। এটি দেখায় যে বর্তমান যুক্তিযুক্ত সিস্টেমগুলি টাস্ক জটিলতার একটি আশ্চর্যজনক সংকীর্ণ ব্যান্ডের মধ্যে কাজ করে এবং একবার তারা নির্দিষ্ট প্রান্তিকতা অতিক্রম করার পরে ব্যর্থতা সবই গ্যারান্টিযুক্ত।

যে কেউ রিয়েল সিস্টেম তৈরির জন্য, এটি একটি সময়োপযোগী বাস্তবতা চেক। যুক্তিযুক্ত চিহ্নগুলি যাদু নয়। বৃহত্তর মডেলগুলি সহজাতভাবে বেশি নির্ভরযোগ্য নয়। এবং আরও টোকেন আরও বেশি প্রচেষ্টা বোঝায় না। শক্তিশালী সিস্টেমগুলির জন্য কাঠামো, ফ্যালব্যাক পরিকল্পনা এবং আপনার মডেলটি কখন তার আরামদায়ক অঞ্চলের বাইরে থাকে সে সম্পর্কে একটি পরিষ্কার ধারণা প্রয়োজন।

প্রযুক্তিগত অন্তর্দৃষ্টি সম্পর্কে আমরা কীভাবে কথোপকথনটি ফ্রেম করি সে সম্পর্কে অ্যাপলের অবদান ততটাই। যদি লক্ষ্যটি হ’ল সিস্টেমগুলি তৈরি করা যা সত্যই যুক্তিযুক্ত, বা কমপক্ষে এটি জাল না করার সময় জানতে পারে তবে ক্ষেত্রটিকে আরও বেশি প্রয়োজন এই ধরণের স্পষ্টতা।